9月10日消息,今日上午,阿布扎比穆罕默德·本·扎耶德人工智能大學(xué)(MBZUAI)聯(lián)合AI創(chuàng)企G42推出的新低成本推理模型K2 Think,相關(guān)論文已a(bǔ)rXiv預(yù)印本平臺(tái)發(fā)表,昨天下午模型在Hugging Face、GitHub上開(kāi)源。

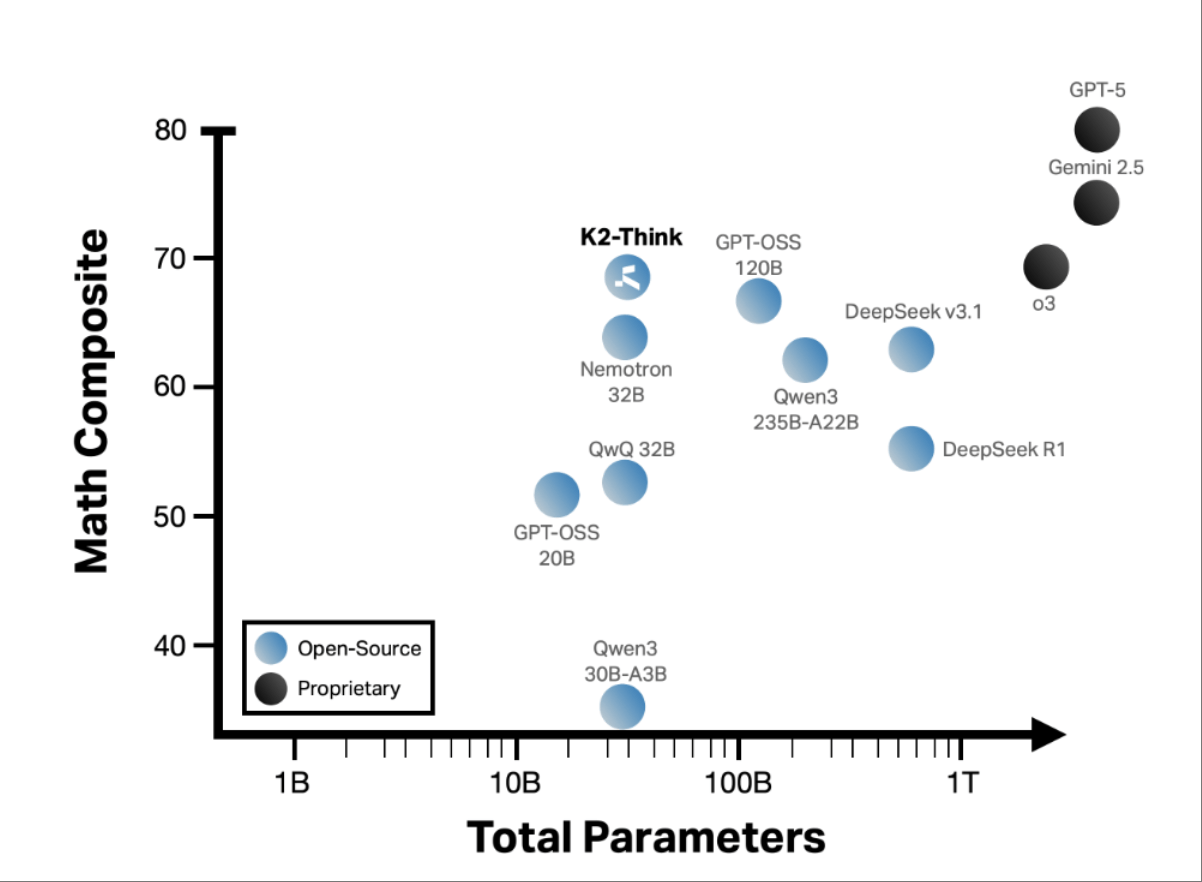

K2 Think有320億個(gè)參數(shù),基于阿里巴巴的開(kāi)源模型Qwen 2.5構(gòu)建,性能超過(guò)參數(shù)規(guī)模是其20倍的OpenAI和DeepSeek旗艦推理模型。

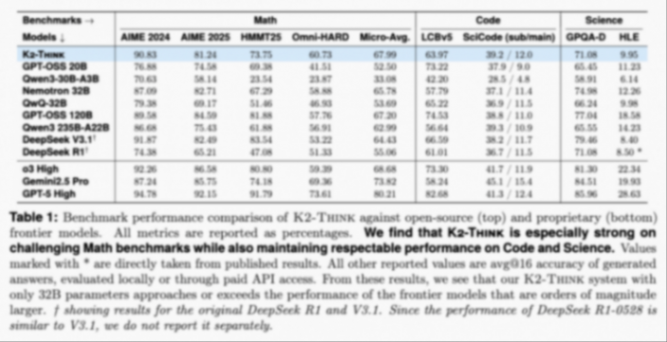

在復(fù)雜數(shù)學(xué)任務(wù)基準(zhǔn)測(cè)試中,研究人員計(jì)算了K2 Think在AIME24、AIME25、HMMT25和OMNI-Math-HARD中的平均得分,超過(guò)GPT-OSS、DeepSeek V3.1、Qwen3 235B-A22B等一眾開(kāi)源模型。

技術(shù)報(bào)告中,研究人員提到K2 Think背后有六大技術(shù)創(chuàng)新協(xié)同,研究人員通過(guò)監(jiān)督微調(diào)擴(kuò)展基礎(chǔ)模型的思維鏈能力,然后通過(guò)可驗(yàn)證獎(jiǎng)勵(lì)強(qiáng)化學(xué)習(xí)(RLVR)增強(qiáng)推理性能、利用推理時(shí)間技術(shù)增強(qiáng)模型,最后在部署K2-Think時(shí)進(jìn)行兩項(xiàng)速度優(yōu)化,包括推測(cè)解碼和Cerebras的晶圓級(jí)芯片,同時(shí)使用公開(kāi)可用的開(kāi)源數(shù)據(jù)集訓(xùn)練。

值得一提的是,研究人員將K2-Think部署在Cerebras晶圓級(jí)芯片WSE系統(tǒng),WSE每秒可交付約2000個(gè)token,相比在NVIDIA H100/H200 GPU等常規(guī)部署環(huán)境中觀測(cè)到的標(biāo)稱每秒200個(gè)token,性能提升了10倍。

K2-Think背后有兩大強(qiáng)力推手:一方是穆罕默德?本?扎耶德人工智能大學(xué)(MBZUAI),這是阿拉伯聯(lián)合酋長(zhǎng)國(guó)專(zhuān)門(mén)設(shè)立、聚焦AI研究的機(jī)構(gòu);另一方是阿布扎比支持的科技集團(tuán)G42,不僅在2024年拿到微軟15億美元投資,還在阿聯(lián)酋建造OpenAI、軟銀等企業(yè)聯(lián)合投資的AI基建 “星際之門(mén)”。

該模型的權(quán)重、訓(xùn)練數(shù)據(jù)、部署代碼和測(cè)試時(shí)優(yōu)化代碼已經(jīng)在Hugging Face、GitHub上開(kāi)源。

Hugging Face地址:

GitHub地址:

K2 Think主頁(yè):

技術(shù)報(bào)告:

https://arxiv.org/abs/2509.07604

一、數(shù)學(xué)性能領(lǐng)先OpenAI、DeepSeek旗下開(kāi)源模型,要為數(shù)學(xué)、科學(xué)提供特定用途服務(wù)

MBZUAI校長(zhǎng)兼首席AI研究員Eric Xing在接受外媒WIRED采訪時(shí)透露,K2 Think是使用數(shù)千個(gè)GPU開(kāi)發(fā)的,最終的訓(xùn)練過(guò)程涉及200到300塊芯片。

K2 Think并非一個(gè)完整的大語(yǔ)言模型,是專(zhuān)門(mén)用于推理的模型,能夠通過(guò)模擬推理方式來(lái)回答復(fù)雜問(wèn)題,而不是快速綜合信息來(lái)提供信息輸出,Xing提到,他們?cè)谖磥?lái)幾個(gè)月將K2 Think整合到一個(gè)完整的大模型中。

在復(fù)雜數(shù)學(xué)領(lǐng)域,K2 Think在AIME 2024、AIME 2025、HMMT 2025 和 Omni-MATH-HARD四個(gè)基準(zhǔn)測(cè)試中的平均得分為67.99分,超過(guò)規(guī)模更大的DeepSeek V3.1 671B、GPT-OSS 120B模型。

編程能力上,K2-Think在開(kāi)源代碼能力基準(zhǔn)LiveCodeBench上獲得63.97分,超越了規(guī)模相近的同類(lèi)模型GPT-OSS 20B、Qwen3-30B-A3B。

在用于評(píng)估大模型將復(fù)雜科學(xué)問(wèn)題轉(zhuǎn)化為可執(zhí)行代碼能力的SciCode基準(zhǔn)測(cè)試中,K2-Think獲得39.2分排名第二,與第一名的Qwen3 235BA22B僅有0.1分之差。

在科學(xué)推理方面,模型在GPQA-Diamond基準(zhǔn)測(cè)試中的表現(xiàn)為71.08,表現(xiàn)優(yōu)于除OpenReasoning-Nemotron-32B、GPT-OSS 120B之外的大多數(shù)開(kāi)源模型。

MBZUAI基礎(chǔ)模型研究所所長(zhǎng)Hector Liu提到,K2-Think的特別之處在于,他們將其視為一個(gè)系統(tǒng),他們的目標(biāo)不是構(gòu)建類(lèi)似ChatGPT的聊天機(jī)器人,而是為數(shù)學(xué)和科學(xué)等領(lǐng)域的特定用途提供服務(wù)。

二、六項(xiàng)系統(tǒng)級(jí)創(chuàng)新,全訓(xùn)練過(guò)程均采用開(kāi)源數(shù)據(jù)集

K2-Think的技術(shù)報(bào)告顯示,其背后有六大技術(shù)創(chuàng)新,包括思維鏈監(jiān)督微調(diào)、可驗(yàn)證獎(jiǎng)勵(lì)強(qiáng)化學(xué)習(xí)(RLVR)、推理前的Agent規(guī)劃、測(cè)試時(shí)擴(kuò)展、推測(cè)解碼和推理優(yōu)化硬件、僅使用公開(kāi)可用的開(kāi)源數(shù)據(jù)集訓(xùn)練。

基于這種系統(tǒng)化的技術(shù)創(chuàng)新,K2-Think通過(guò)長(zhǎng)鏈?zhǔn)剿季S監(jiān)督微調(diào)增強(qiáng)了邏輯深度、可驗(yàn)證獎(jiǎng)勵(lì)的強(qiáng)化學(xué)習(xí)提高了解決難題的準(zhǔn)確率、Agent式規(guī)劃使模型能夠在推理前分解復(fù)雜挑戰(zhàn)、測(cè)試時(shí)擴(kuò)展技術(shù)進(jìn)一步提升了模型的適應(yīng)性,最終實(shí)現(xiàn)性能對(duì)標(biāo)更大參數(shù)規(guī)模模型。這使得模型能夠提供強(qiáng)大的思維鏈推理能力和近乎即時(shí)的響應(yīng)時(shí)間。

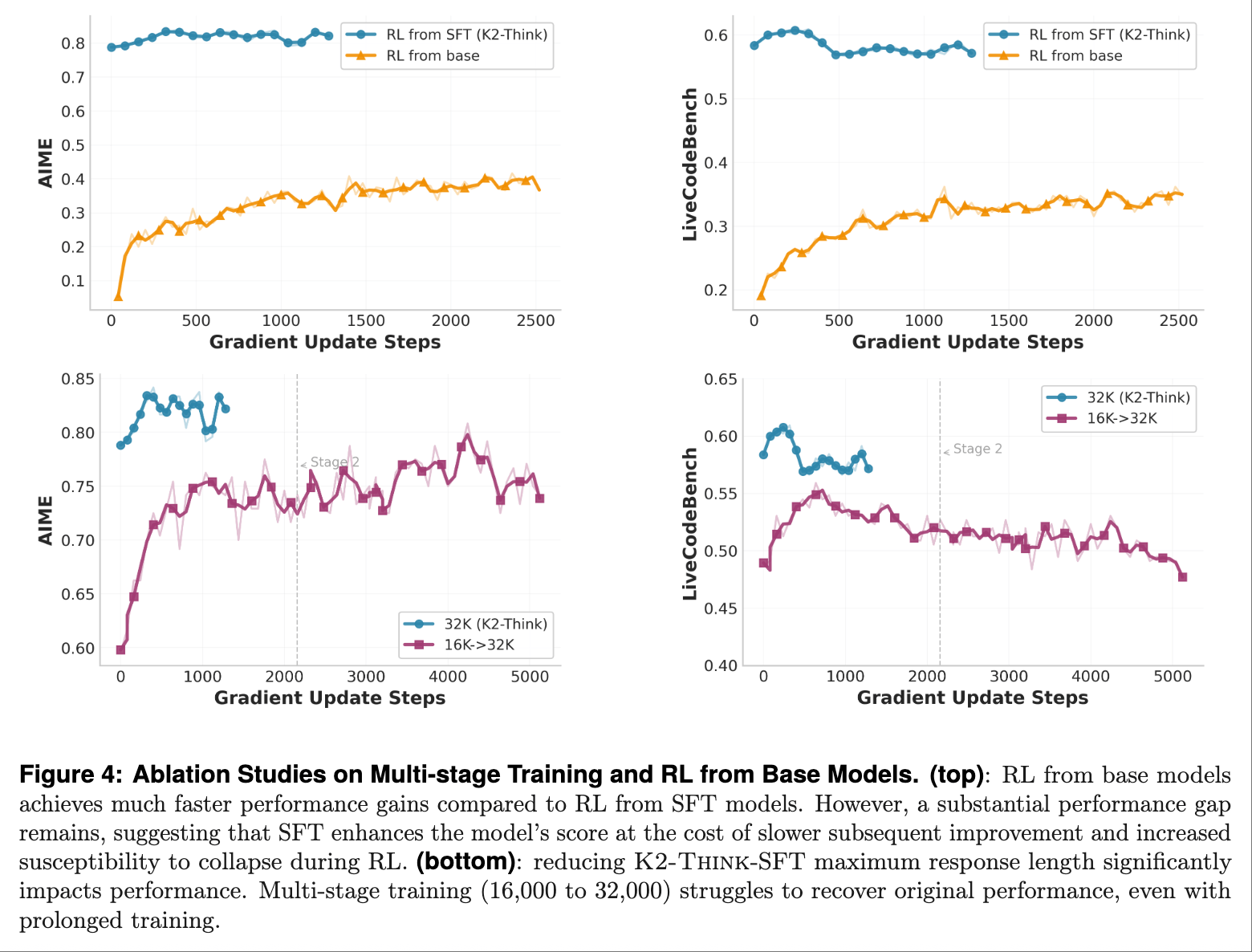

在監(jiān)督微調(diào)階段,K2-Think使用思維鏈對(duì)基礎(chǔ)模型進(jìn)行監(jiān)督微調(diào)。研究人員采用了現(xiàn)有的AM-Thinking-v1-Distilled數(shù)據(jù)集,該數(shù)據(jù)集由CoT推理痕跡和指令/響應(yīng)對(duì)組成,提示來(lái)自數(shù)學(xué)推理、代碼生成、科學(xué)推理、指令遵循和一般聊天等任務(wù)。他們?cè)u(píng)估發(fā)現(xiàn),SFT模型在各個(gè)采樣預(yù)算下均優(yōu)于基礎(chǔ)模型。

在可驗(yàn)證獎(jiǎng)勵(lì)強(qiáng)化學(xué)習(xí)階段,可驗(yàn)證獎(jiǎng)勵(lì)強(qiáng)化學(xué)習(xí)通過(guò)直接優(yōu)化模型生成的正確性,降低了基于人類(lèi)反饋強(qiáng)化學(xué)習(xí)(RLHF)基于偏好對(duì)齊的復(fù)雜性和成本。因此研究人員使用了Guru數(shù)據(jù)集,該數(shù)據(jù)集包含數(shù)學(xué)、編程、科學(xué)、邏輯、模擬和表格六個(gè)領(lǐng)域任務(wù)、近92000個(gè)可驗(yàn)證問(wèn)題。

在測(cè)試時(shí)間改進(jìn)階段,為了進(jìn)一步提升模型性能,研究人員開(kāi)發(fā)了測(cè)試時(shí)框架,為訓(xùn)練后的推理模型提供結(jié)構(gòu)化輸入,包括推理前的Agent規(guī)劃,即“先計(jì)劃后思考”,以及使用Best-of-N采樣的測(cè)試時(shí)擴(kuò)展。

▲模型從輸入到最終響應(yīng)的信息流

從輸入到最終響應(yīng)時(shí),模型會(huì)重構(gòu)提示以概述總體規(guī)劃、突出相關(guān)概念。然后這一增強(qiáng)的提示將通過(guò)K2-Think模型生成多個(gè)響應(yīng),最后對(duì)候選響應(yīng)進(jìn)行兩兩比較,最終選出最佳生成結(jié)果作為推理系統(tǒng)的最終輸出。

第四階段是部署,在具有挑戰(zhàn)性的數(shù)學(xué)證明或多步驟編碼問(wèn)題中,一個(gè)典型復(fù)雜推理任務(wù)一般會(huì)生成32000個(gè)token的響應(yīng)。在NVIDIA H100上,這可以在不到3分鐘的時(shí)間內(nèi)完成,在WSE上,同樣32000個(gè)token的生成任務(wù)只需16秒。

這是因?yàn)镚PU必須在每個(gè)token生成時(shí)不斷將權(quán)重從高帶寬內(nèi)存?zhèn)鬏數(shù)紾PU核心,而WSE將所有模型權(quán)重存儲(chǔ)在海量片上內(nèi)存中,充分利用每秒25PB的片上內(nèi)存帶寬,比最新NVIDIA B200 GPU提供的0.008PB/s高出3000多倍。

結(jié)語(yǔ):小參數(shù)模型經(jīng)后期訓(xùn)練,可媲美更大參數(shù)模型

K2-Think模型的性能證明,320億參數(shù)規(guī)模的模型經(jīng)過(guò)后期訓(xùn)練,能夠生成較長(zhǎng)的推理思路鏈,并結(jié)合相對(duì)較少的測(cè)試時(shí)間計(jì)算,可以實(shí)現(xiàn)小模型與參數(shù)數(shù)量級(jí)更大的模型相媲美的能力。

MBZUAI基礎(chǔ)模型研究所的總經(jīng)理Richard Morton認(rèn)為,人腦的基本推理是所有思維過(guò)程的基礎(chǔ),K2-Think的應(yīng)用,可以縮短研究人員思考特定任務(wù)、進(jìn)行臨床試驗(yàn)的時(shí)間,從而將先進(jìn)的AI技術(shù)擴(kuò)大到AI基礎(chǔ)設(shè)施稀缺的地區(qū)。